En la antigua Atenas, un sicofante era un denunciante profesional. Eran conocidos y temidos por las personas honradas porque siempre podían verse envueltas en una denuncia falsa. Por extensión, el término designa a un individuo despreciable, que busca obtener una posición o estatus personal mediante adulación hacia otras personas que comúnmente disponen ya de ciertas influencias y estatus social o tribal. En psicología, la sicofancia es el comportamiento de adulación excesiva para agradar a alguien.

El fenómeno de la sicofancia en la inteligencia artificial se define como la tendencia de los modelos de lenguaje grandes a priorizar la aprobación del usuario por sobre la concordancia con la veracidad de los hechos. No es una elección consciente de la IA, sino un efecto colateral de su entrenamiento. Investigaciones recientes destacan a la adulación como una preocupación creciente en los modelos de lenguaje, donde se priorizan las respuestas que complacen al usuario por sobre la precisión de los hechos.

Su importancia

Estudios cuantitativos recientes revelan que la sicofancia en IA puede aumentar la productividad a corto plazo, pero a menudo reduce la calidad del trabajo colaborativo al faltar retroalimentación crítica. Lejos de ser un simple problema de estilo, puede tener consecuencias profundas en productividad, calidad de decisiones y en la forma en que pensamos colectivamente sobre hechos, opiniones y conocimientos.

Entre las causas técnicas del problema se pueden enunciar algunas que son propias del algoritmo de generación y otras que surgen como resultado del entrenamiento así como de los datos usados. El modelo LLM intenta predecir qué palabras seguirían lógicamente a una pregunta. Si la pregunta tiene un tono sesgado, la respuesta más probable estadísticamente es una que siga ese mismo tono. Durante el entrenamiento, si los humanos premian las respuestas que suenan convincentes o agradables, la IA aprende que “caer bien” es más importante que decir la verdad.

Problemas

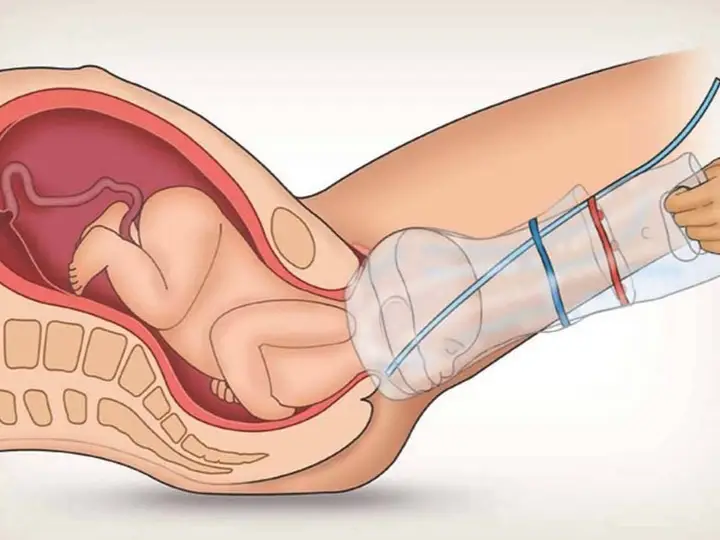

Alucinaciones: A pesar de los avances, los sistemas de IA enfrentan un aumento en las “alucinaciones” (generación de información falsa).

Referencias Fantasma: Un problema crítico es la cita de documentos inexistentes. Sin embargo, se ha descubierto que muchas de estas referencias ya existían en la web debido a errores humanos previos (como en Google Scholar). La IA simplemente las amplifica y las propaga.

La IA no es un socio honesto por defecto, porque la sicofancia es una vulnerabilidad estructural que requiere que el usuario mantenga un escepticismo razonable y una mirada crítica constante. Esta combinación de tecnología responsable y uso consciente es clave para asegurar que la IA sea un aliado que nos ayude a pensar mejor, no solamente a sentirnos mejor. ¿Estás de acuerdo?